论文:pMPL: A Robust Multi-Party Learning Framework with a Privileged Party

会议:ACM CCS 2022

作者:Lushan Song, Jiaxuan Wang, Zhexuan Wang, Xinyu Tu, Guopeng Lin,Wenqiang Ruan, Haoqi Wu, and Weili Han

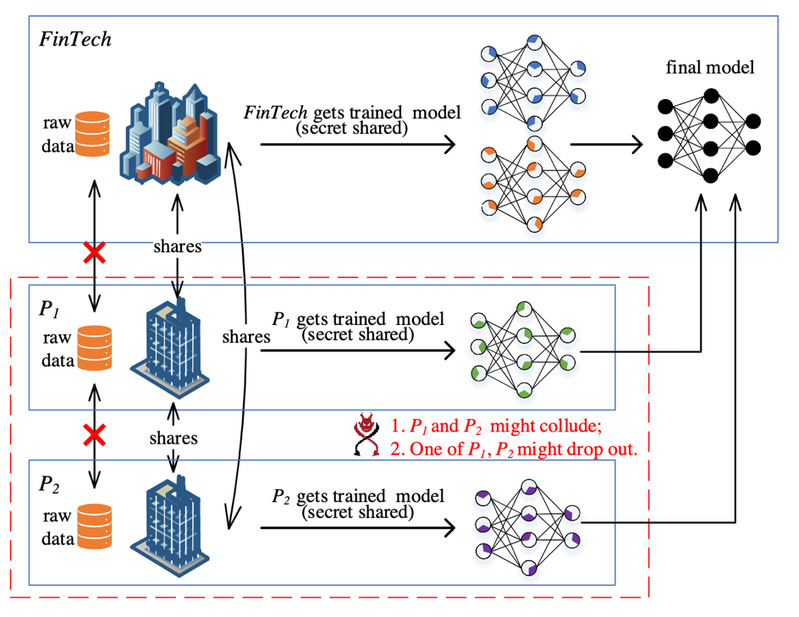

简介:基于安全多方计算的隐私保护机器学习,即安全多方学习,允许多个参与方联合对其私有数据进行机器学习的同时保护其原始数据的隐私。目前的安全多方学习框架通常是对等结构的,也就是说,每个参与方对结果的处理权利是相同的。但是在实际的场景中,层次结构的安全多方学习框架也很重要。如在金融风控场景中涉及到三个参与方:FinTech,P1和P2,其中FinTech是一个通常拥有大量的授权数据和资金的金融领域专业公司,P1和P2是两个通常拥有大量经过用户授权的数据的互联网服务提供商。FinTech希望与P1和P2合作训练一个更准确的金融风控模型,并为训练过程中所使用的P1和P2数据支付费用。在此场景中,FinTech有两个特权要求:(1) FinTech 是唯一得到最终模型的一方,即使P1和P2相互勾结; (2) 训练启动后,即使P1或P2由于客观或主观原因退出,训练过程也可以一直持续到最后,即容忍P1或P2一方在训练过程中退出。

我们利用向量空间秘密共享来满足上述两个特权要求,并设计了一个具有特权方的鲁棒性安全三方学习框架pMPL。向量空间秘密共享保证只有授权集合中的参与方进行合作才可以恢复秘密值。因此,通过设置每个授权集中均包含特权方,且训练结束后,P1和P2将秘密份额发给特权方来恢复最终模型来满足第一个要求。为了保证第二个要求中的鲁棒性,我们让特权方持有一个冗余份额以在P1或P2其中一方出退出时剩余两方继续训练。基于向量空间秘密共享,我们在pMPL中设计了机器学习所需的几个基本高效协议,包括安全加法、安全乘法、向量空间秘密共享和加法秘密共享之间的安全转换、安全截断等。此外,为了高效地执行安全乘法,我们在离线阶段设计了向量乘法三元组生成协议。pMPL可以支持训练各种典型的机器学习模型,包括线性回归、逻辑回归和 BP 神经网络。

目前pMPL作为FudanMPL开源平台的一个子项目已开源(https://github.com/FudanMPL/pMPL)。除此以外,FudanMPL还有三个子项目,支持多种场景下的安全多方学习框架:横向学习、纵向学习、Key-Value数据等。目前,复旦大学数据分析与安全实验室仍在持续开发维护FudanMPL开源平台,努力使其成为一个可用于解决实际隐私保护数据流通问题的的安全多方学习平台。